Hướng đi nào cho nguyên tắc phát triển AI tại Việt Nam?

Trong bối cảnh trí tuệ nhân tạo (AI) phát triển nhanh chóng, việc xây dựng các nguyên tắc quản trị và đạo đức trở thành nhiệm vụ cấp thiết. Đối với Việt Nam

Trong bối cảnh trí tuệ nhân tạo (AI) phát triển nhanh chóng, việc xây dựng các nguyên tắc quản trị và đạo đức trở thành nhiệm vụ cấp thiết. Đối với Việt Nam, hành trình chuyển đổi số đòi hỏi một bộ nguyên tắc riêng, vừa khuyến khích đổi mới công nghệ, vừa đảm bảo giá trị đạo đức và lợi ích quốc gia. Cân bằng giữa các yếu tố này không chỉ đơn thuần là tuân thủ tiêu chuẩn quốc tế, mà còn là bài toán chiến lược dài hạn.

Từ cam kết đạo đức đến hợp tác quân sự

Mới đây, Google đã âm thầm cập nhật nguyên tắc về AI, loại bỏ cam kết không sử dụng AI cho phát triển vũ khí, giám sát hay các công nghệ gây hại. Điều này đánh dấu bước ngoặt quan trọng, mở ra khả năng tham gia vào các dự án quân sự và hợp tác quốc phòng.

Trước đó, Google từng tham gia các hợp đồng quân sự như Project Maven (2018) - phân tích hình ảnh từ drone cho Lầu Năm Góc và Project Nimbus (2021) - hợp đồng điện toán đám mây quân sự với Israel. Những thỏa thuận này gây tranh cãi nội bộ, khi nhiều nhân viên lo ngại công ty vi phạm các nguyên tắc đạo đức đã đặt ra.

Không chỉ Google, OpenAI cũng thay đổi chính sách khi bỏ lệnh cấm sử dụng AI trong quân sự, mở đường cho hợp tác với Anduril Industries để cải thiện hệ thống chống drone của Mỹ. Những thay đổi này phản ánh xu hướng toàn cầu khi các tập đoàn công nghệ chấp nhận vai trò trong lĩnh vực quốc phòng, dù đi kèm rủi ro về mất cân bằng giữa an ninh, kinh tế và đạo đức.

Sự đa dạng trong chính sách AI toàn cầu

Quá trình hoạch định chính sách AI trên thế giới cho thấy sự khác biệt đáng kể giữa các quốc gia:

- Mỹ: Chính quyền Joe Biden thúc đẩy quản lý AI dựa trên đạo đức, trong khi chính quyền Donald Trump lại ưu tiên phát triển AI với ít ràng buộc, đặc biệt trong lĩnh vực quân sự.

- Liên minh châu Âu (EU): Đạo luật AI của EU phân loại rủi ro, cấm sử dụng AI trong các ứng dụng nguy hiểm, bảo vệ quyền con người và an ninh quốc gia.

- Trung Quốc: Chưa ban hành bộ nguyên tắc cụ thể, tạo nên sự khác biệt trong cách tiếp cận AI so với phương Tây.

Việt Nam cũng đang nỗ lực xây dựng khung pháp lý phù hợp. Hiệp hội Phần mềm và Dịch vụ CNTT Việt Nam đã thành lập Ủy ban Đạo đức AI, trong khi Bộ Khoa học và Công nghệ ban hành Quyết định 1290/QĐ-BKHCN (11/6/2024) hướng dẫn nguyên tắc phát triển AI có trách nhiệm. Bên cạnh đó, dự thảo Luật Công nghiệp công nghệ số yêu cầu thiết lập nguyên tắc đạo đức trong phát triển và ứng dụng AI.

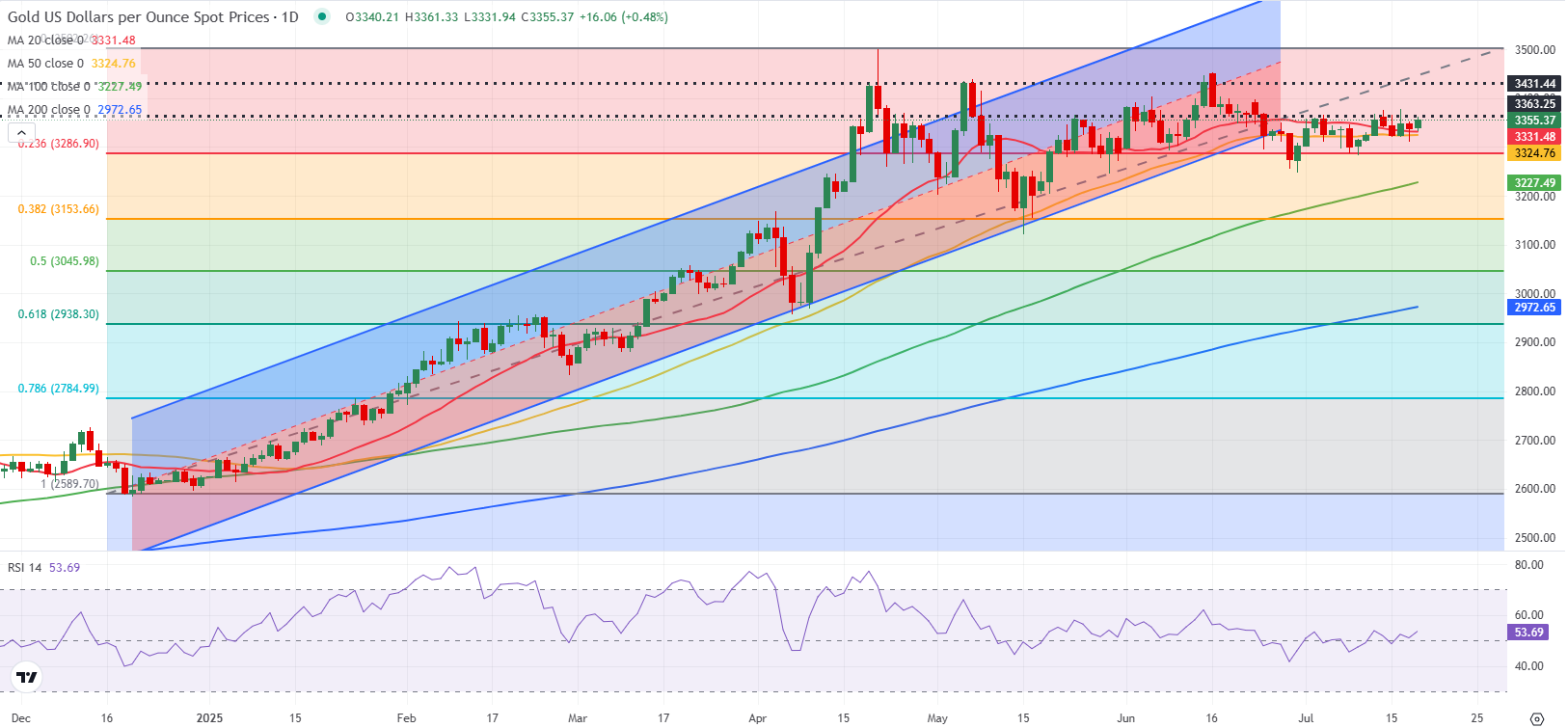

- Tham khảo kế hoạch giao dịch VÀNG - TIỀN TỆ mới nhất hàng ngày tại TELEGRAM: Giao Lộ Đầu Tư

Không chỉ xét về giá trị đạo đức

Việt Nam cần xây dựng một bộ nguyên tắc linh hoạt, không rập khuôn mô hình quốc tế mà phù hợp với lợi ích quốc gia. Bên cạnh đạo đức và an toàn, yếu tố chiến lược - từ an ninh quốc phòng đến kinh tế - cũng phải được cân nhắc.

Chiến lược phát triển AI của Việt Nam cần gắn liền với ngành công nghiệp bán dẫn, theo công thức “C = SET + 1”:

- C (Chip): Đẩy mạnh công nghiệp bán dẫn.

- S (Specialized): Phát triển chip chuyên dụng.

- E (Electronics): Thúc đẩy công nghiệp điện tử.

- T (Talent): Đào tạo nhân tài AI.

- +1 (Việt Nam): Đưa Việt Nam thành điểm đến an toàn trong chuỗi cung ứng công nghệ.

Đây không chỉ là tầm nhìn kỹ thuật mà còn là chiến lược dài hạn, giúp Việt Nam khẳng định vị thế trong kỷ nguyên AI toàn cầu, theo đúng tinh thần Nghị quyết 57-NQ/TW về đổi mới sáng tạo và chuyển đổi số quốc gia.